Comment structurer un site pour optimiser le crawl de Google ?

En tant qu’expert en référencement naturel, l’architecture de votre site est votre levier le plus puissant pour guider les robots là où se trouve la valeur.

Le budget de crawl n’est pas illimité. Si les robots de Google (Googlebot) perdent leur temps sur des pages inutiles ou se heurtent à une architecture confuse, vos pages stratégiques risquent de ne jamais être indexées… et encore moins positionnées.

Voici le guide ultime pour structurer votre site pour le crawl de Google.

1. L’architecture de l’information : La règle des 3 clics

L’un des premiers critères d’un bon crawl est la profondeur de navigation. Plus une page est profonde, moins elle reçoit d’autorité (PageRank interne) et moins Google la visite.

La structure en silo (ou Siloing)

Le siloing consiste à regrouper vos contenus par thématiques étanches. Cela aide Google à comprendre la cohérence sémantique de votre site.

-

Niveau 1 : Page d’accueil

-

Niveau 2 : Catégories principales (ex: Développement Web, Webdesign, SEO)

-

Niveau 3 : Sous-catégories ou articles précis.

💡 La règle d’or : N’importe quelle page importante de votre site doit être accessible en 3 clics ou moins depuis la page d’accueil.

2. Le maillage interne : Le réseau routier de Googlebot

Googlebot découvre de nouvelles pages en suivant des liens. Si une page n’est liée à aucune autre, c’est une page orpheline : elle est invisible pour Google.

Les bonnes pratiques du maillage interne :

-

Utilisez des ancres de texte descriptives : Évitez les « Cliquez ici ». Préférez « découvrir nos services de création web ».

-

Le fil d’Ariane (Breadcrumbs) : C’est un indispensable. Il crée automatiquement des liens logiques et hiérarchiques vers les niveaux supérieurs.

-

Le maillage contextuel : Liez vos articles de blog entre eux lorsqu’ils traitent de sujets complémentaires.

3. Le contrôle du Crawl : Robots.txt et balises Meta

Vous ne voulez pas que Google perde son temps sur votre page de conditions générales de vente ou sur les scripts de votre panier d’achat. Il faut lui indiquer la route.

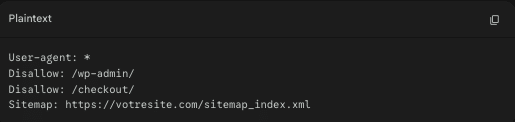

Le fichier robots.txt

C’est le premier fichier que Google consulte. Il sert à interdire l’accès à certaines zones.

La balise robots (noindex)

Si vous voulez que Google voie une page mais ne l’affiche pas dans les résultats de recherche, utilisez la directive noindex dans le code HTML : <meta name="robots" content="noindex, follow">

4. Les plans de site (Sitemaps) : Le GPS de Google

Le Sitemap XML est un fichier qui liste toutes les URL importantes de votre site que vous souhaitez voir indexées.

Comment bien l’exploiter ?

-

Gardez-le propre : N’y mettez que des pages en code HTTP 200 (pas de redirections 301, pas de pages d’erreur 404, pas de

noindex). -

Déclarez-le : Soumettez-le dans votre Google Search Console et mentionnez-le à la fin de votre fichier

robots.txt. -

Sitemaps spécialisés : Si vous avez beaucoup de médias, n’hésitez pas à créer des sitemaps dédiés aux images ou aux vidéos.

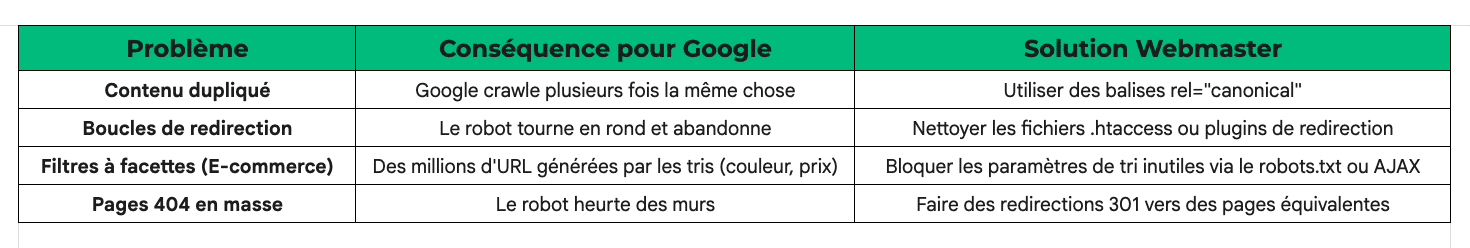

5. Éviter les pièges qui gaspillent le Budget de Crawl

Google peut se retrouver coincé ou perdre patience sur votre site à cause de « pièges à crawl » classiques.

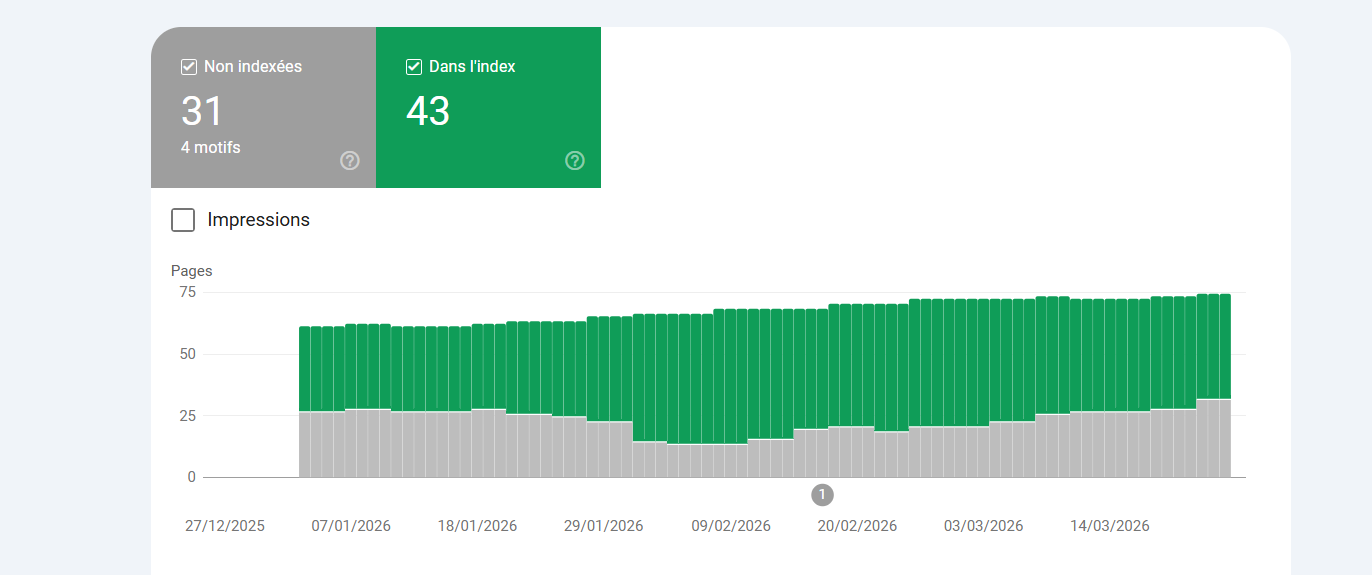

6. Mesurer et analyser avec la Search Console

On ne peut pas optimiser ce qu’on ne mesure pas. La Google Search Console est votre meilleur outil de monitoring.

-

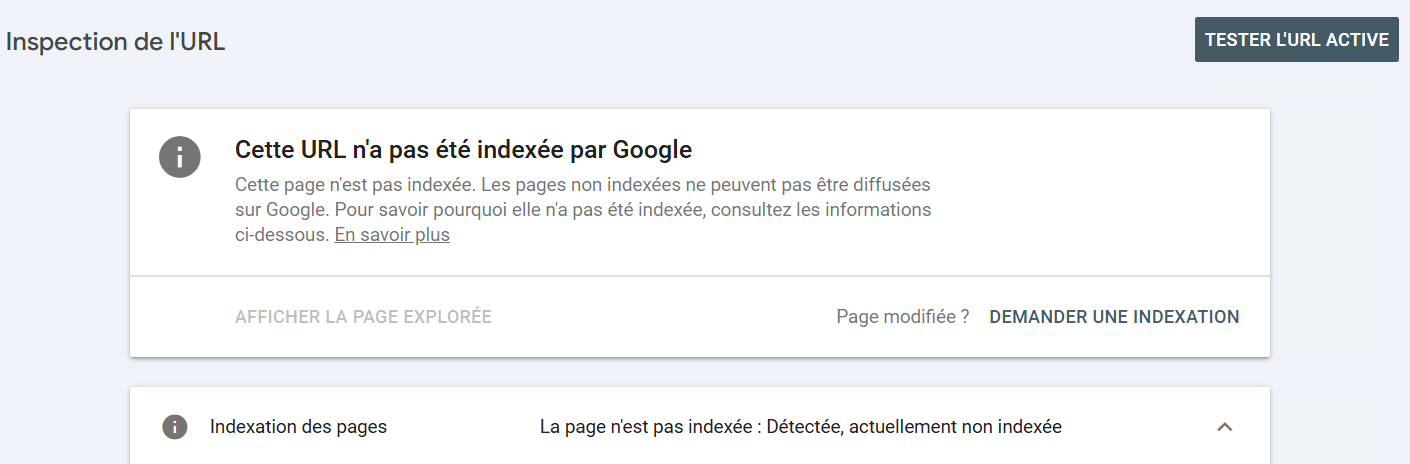

Rapport de couverture (Indexation) : Vérifiez quelles pages sont exclues et pourquoi.

-

Statistiques de crawl : (Accessibles dans les paramètres). Vous verrez combien de requêtes Googlebot fait par jour et quel est le temps de réponse moyen de votre serveur. Si le temps de réponse augmente, Google ralentira son crawl.

Structurer un site pour le crawl de Google n’est pas une action ponctuelle, mais une hygiène de développement à maintenir au quotidien. En offrant une structure logique, un maillage interne fluide et des directives claires (robots.txt, sitemaps), vous transformez votre site en autoroute pour les robots d’indexation.

Le résultat ? Vos nouveaux contenus sont indexés plus vite et vos positions s’améliorent grâce à une meilleure distribution du PageRank.

FAQ

Quelle est la différence entre le crawl et l'indexation ?

Le crawl (ou exploration) est l’étape où les robots de Google parcourent votre site pour en découvrir le code et le contenu. L’indexation est l’étape suivante, où Google décide d’analyser ce contenu et de l’ajouter à sa base de données pour l’afficher dans les résultats de recherche. Une page crawlée n’est donc pas automatiquement indexée !

Faut-il mettre toutes les pages inutiles en "noindex" ?

Pas n’importe comment ! Si vous mettez une page en noindex, Google doit quand même la crawler pour voir cette consigne. Si vous voulez que Google ne perde aucun temps sur une section (par exemple, un espace membre lourd), il est préférable d’utiliser le fichier robots.txt pour bloquer l’accès en amont.

Est-ce que la vitesse du site impacte le crawl ?

Oui, directement. Googlebot s’alloue un certain temps pour visiter votre site. Si votre serveur est lent à répondre, le robot consommera son temps alloué sur deux ou trois pages seulement, puis partira. Un site rapide permet à Google de crawler plus de pages en moins de temps.

Qu'est-ce qu'une page orpheline et comment la détecter ?

Une page orpheline est une page publiée sur votre site, mais qui ne reçoit aucun lien depuis vos autres pages. Googlebot ne peut pas la trouver naturellement via le crawl interne. Vous pouvez les détecter en comparant la liste des URL de votre Sitemap XML (ou de vos logs serveurs) avec la liste des pages trouvées lors d’un crawl avec un outil comme Screaming Frog.

0 commentaires